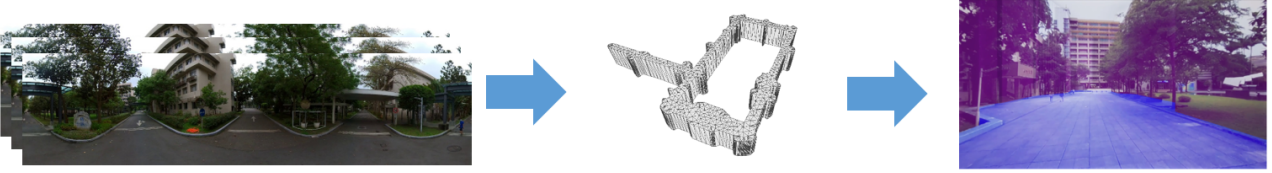

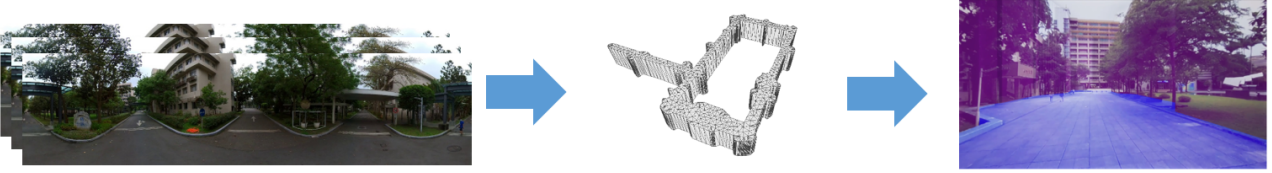

"本研究所提出一套戶外場景重建系統。系統輸入為360影像,可透過市面上通用的商用360攝影機進行拍攝,若是一般攝影機或是魚眼相機則必須對影像進行影像拼接,搭配系統提供的影像拼接系統可將數張魚眼相機拍攝的廣角圖像拼接成全景圖,拼接過程同時會對影像進行最佳化的對位與色彩的融合,以利於產生一張較佳的全景圖。我們利用全景圖影像作為輸入並通過我們的系統重建出3D 場景網格。重建的第一步是須對全景圖進行語義分割(Semantic Segmentation),找出所有屬於道路的像素。接著對全景影像進行深度預測(Depth Estimation),透過使用方法估算出道路大致的深度。系統從語義分割的結果中找出道路的像素,然後通過深度預測的深度建立道路的點雲,通過演算法計算出相機大致的高度,並且依照相機高度重新建立更平滑的點雲平面。

我們對每一幀的影像建立對應的點雲,系統透過同時定位與地圖建構(SLAM) 的技術對攝影機位置進行估算估算位置後進行對齊。由於SLAM 的單位與產生的網格存在比例上的差異,因此需要針對SLAM的結果進行比例的縮放縮放,以確保兩者能再。接著利用每一片點雲與對應的SLAM 計算的相機的坐標與旋轉角度,將點雲從轉換至世界坐標,將所有點雲進行對齊,最後得到一個完整的道路的點雲。當系統建立好完整的道路點雲後,接下來會將道路點雲進行網格重建。我們將點雲投影到一個2D 圖像上,我們通過那個圖像來找出道路的整體輪廓。接著我們會依照輪廓的邊作為約束,使用約束德洛涅三角化(Constrained-Delaunay Triangulation) 進行三角化,建立出一個2D 的道路平面網格。當我們有了平面的網格,最後我們沿著2D 平面的網格的邊緣建立牆壁,最後加上天花板,最終完成網格重建。對於貼圖的部分,我們使用了影片播放的方式,我們根據相機當前的位子,與及當前播放的全景圖圖像對模型進行投影的,而貼圖是透過全景圖影片的切換的方式獲。

重建好戶外的3D 網格模型之後,我們能夠利用該網格是做成一些應用。我們能在3D 場景裡放置了一些導航箭頭、隨機行走的NPC與一些3D互動物件,讓使用者能夠在我們的3D 常場景裡自由地沿著路徑向前/向後移動,360 度旋轉相機,讓使用者能夠到處觀察四周場景,並且能夠隨時與場景裡的物件做一些互動。"

國立台灣工業技術學院成立於民國六十三年八月一日,為我國第一所技術職業教育高等學府以招收大學部學生為主。建校之目的,在因應我國經濟與工業迅速發展之需求,以培養高級工程技術及管理人才為目標,同時建立完整之技術職業教育體系。於六十八年及七十一年起分別設置碩、博士班,八十六年改名為「國立臺灣科技大學」。本校校地含臺北總校區、公館新校地、土城野外試驗場、基隆坡地工程研究試驗站及新竹分部,目前校地面積34.3公頃,校舍建築總樓地板面積24萬9,111平方公尺,校本部位於臺北市基隆路四段43號。至112學年度大學部學生約5,593位,研究生約6,079位,專任(含專案)教師約548位。

技術成熟度:實驗室階段

展示目的:研發成果展示

流通方式:自行洽談

*服務單位

*姓名

*電話

*您參觀這項展品的主要目的?

*您是否希望進一步洽談

*您的職務類別

*展覽整體評價

*最喜歡的展區

*期待展覽著重的技術領域

*是否願意收到電子報/最新資訊

其他建議

敬請期待!